视频会议的应用基础在于便利性与交互性,基于TCP/IP协议的视频会议系统把视频、音频、文字等多媒体信息超越时空限制呈现在人们眼前,这给人们带来极大便利性的同时也为实时交互提供了条件。目前,视频会议设备对音频与视频的通信质量非常重视,不断在画质和降噪等基础技术层面上取得进步。

然而,视频会议的未来发展显然不止于此,至少在可预见的时间内,还能在交互方面进一步突破发展。特别是随着AI人工智能时代的到来,以及在各领域日益发挥着重要应用价值,也必然会深刻影响并参与视频会议领域的变革。下面,我们将重点探讨AI在视频会议设备上的初步应用及影响。

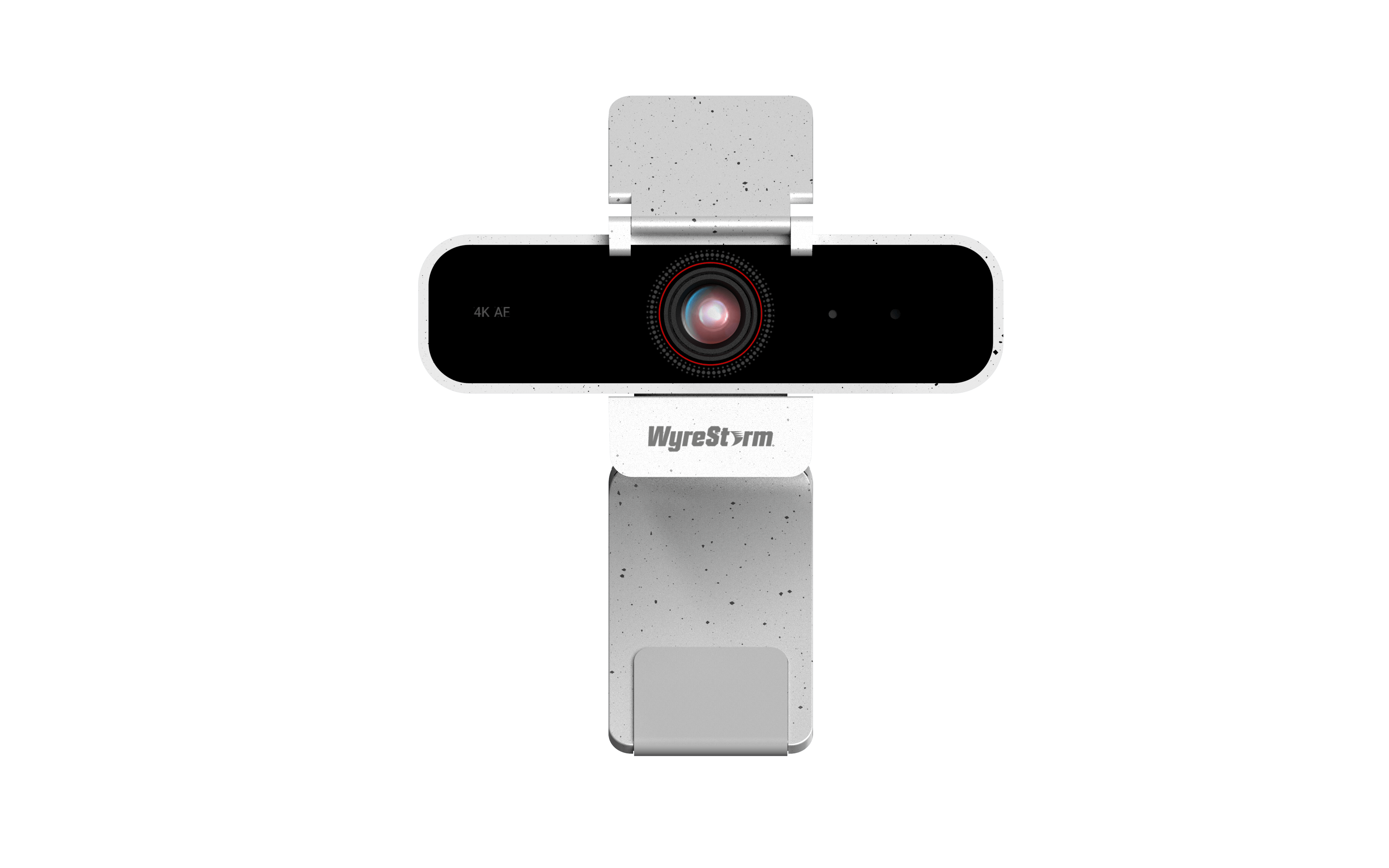

初级AI在摄像头设备上的机会

AI人工智能是新一代“通用目的技术”,对企业的发展能产生深刻影响。虽然在初级人工智能阶段,其在短时间内对业绩的贡献有限,但应用到企业内部经营过程,会为企业带来变革机遇。而在视频会议领域,尤其是在摄像头设备上,AI的普及将显著加速视频通讯技术的发展,这几乎是包含所有的会议情境。

从人脸抓拍到检测、跟踪、识别及行为分析等,AI在摄像头上优势是巨大的,因为即便是复杂的会议环境,AI技术的应用都能显著提升摄像头拍摄的准确度、性能、效率以及稳定性。随着AI技术迅速演进发展,深度学习算法日新月异,如Auto-Framing、Speaker-Tracking、Presenter-Tracking,不胜枚举,在新算法和技术的支持下,人与摄像头的人机交互以及人与人之间的协作将更加自然真实。

Auto-Framing原理及应用

Auto-Framing即智能取景,也称为自动框选,是一项在会议摄像头或者会议一体机上已经十分普及的技术。Auto-Framing智能取景技术分两步进行,自动取景和实时变焦控制。实现自动取景的图像处理可分为四个步骤:图像预处理、运动区域的提取、肤色匹配、计算目标位置,经过复杂的算法处理,摄像头能够识别视野范围内人员的变动并将所有人囊括在内,然后再进行实时变焦控制,即改变成像镜头的焦距和视场,使得所有人员以合适的大小出现在视场中心。

简单来说,Auto-Framing技术有点类似自动EPTZ功能,允许用户以数字方式缩放摄像头的可视区域和视频图像,移动并裁剪该画面,以获得最佳会议视角及构图。苹果公司在新发布的Studio Display中也置入了此项技术,人物居中功能让你在来回走动时依然你保持在画面中间,有人加入或离开画面,镜头视角则会相应扩大或拉进。Auto-Framing的应用,让视频会议变得更加智能。

Speaker-Tracking其技术特点

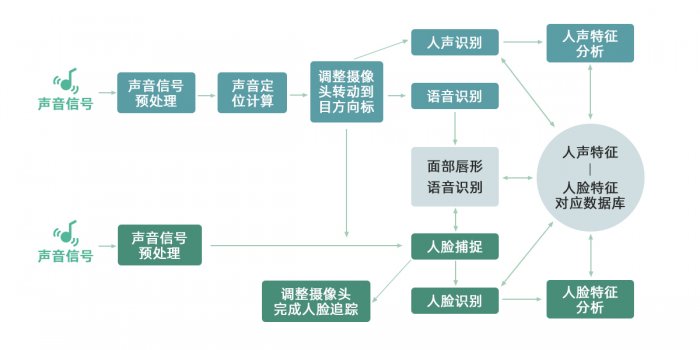

Speaker-Tracking发言人追踪,是一项声音和视觉结合的追踪技术,大多数用于人机交互领域和机器人领域。其技术特点是,摄像头内置麦克风先对声音信号进行数据采集,经AI算法实现对声音信号方位的定位,然后摄像头转向被测发言人,摄像头采集图像传给视觉追踪系统,视觉追踪系统会立刻生成特征物体,当物体发声移动之后,声音追踪系统会立即对被测物体进行重新方位定位,同时视觉追踪系会在摄像头的视野范围内寻找特征图像,寻找到后再把结果显示在屏幕上。

然而,现实的会议环境中,声音信号很容易被环境中的噪声和低头交谈声等干扰,并且发言人的声音信号往往比周围环境中的噪声等声音强度要小很多,因此,对有用声音信号的放大是声音信号追踪过程中需要同步进行的操作。值得称赞的是,当不同发言人分别进行发言时,画面还能实现在发言人之间的顺滑切换。

Presenter-Tracking算法与优化

目标跟踪是利用一个视频或图像序列的上下文信息,对目标的外观和运动信息进行建模,从而对目标运动状态进行 预测并标定目标位置的一种技术。其应用已经渗透到各个领域,包括智能监控、智能人机交互、视频会议等方面。Presenter-Tracking演讲者跟踪,是目标跟踪算法在视频会议领域的一种应用方式,其改进了早期基于滤波的跟踪算法通过响应图确定的目标位置不够准确的问题。

Presenter-Tracking演讲者跟踪利用深度学习技术,通过提取目标特征,无论人脸朝向何处,都能实现流畅的人形跟踪,适用于发言人需要移动讲解的视频会议场景。深度学习是一种复杂的机器学习算法,通过对样本数据的内在规律进行学习,获取样本的深层次特征,进而更好的完成对样本的解释。目标跟踪的优化方向为基于显著性区域加权的相关滤波目标跟踪算法,采用改进的残差网络来提取多分辨率的特征,将视觉显著性引入相关滤波来对响应图进行显著性加权,提高目标的定位精度。